Las revisiones manuales y herramientas como SAST y DAST siguen siendo esenciales, pero tienen dificultades con la escala, el contexto y la velocidad de corrección. Con volúmenes crecientes de código -y cada vez más escrito por IA-, las organizaciones necesitan formas más rápidas e inteligentes de detectar y corregir los fallos de seguridad.

Ahí es donde la IA está empezando a cambiar el funcionamiento de la seguridad de las aplicaciones. Las herramientas modernas no sólo detectan vulnerabilidades, sino que sugieren soluciones, explican los problemas en un lenguaje sencillo y se integran en los flujos de trabajo de los desarrolladores. En este artículo, exploraremos cómo se está utilizando la IA en la seguridad de las aplicaciones: cómo detecta y corrige vulnerabilidades, cómo están adoptando los equipos estas herramientas hoy en día, dónde se quedan cortas y cómo se presenta el futuro de la seguridad impulsada por la IA.

Cómo la IA está cambiando a mejor la seguridad de las aplicaciones

La IA está remodelando la seguridad de las aplicaciones yendo más allá de los métodos de detección tradicionales. Mientras que herramientas como SAST y DAST se centran en la identificación y clasificación de vulnerabilidades, los sistemas de IA aplican una comprensión más profunda del código para ofrecer soluciones procesables y conscientes del contexto. El resultado es una detección más rápida, una clasificación más inteligente y, cada vez más, una corrección automatizada. Estas son las principales formas en que la IA está Improving AppSec hoy en día:

Detección y priorización automatizadas de vulnerabilidades

Los sistemas de IA utilizan grandes modelos de lenguaje (LLM) y aprendizaje automático para comprender la estructura del código, el flujo de datos y la intención. La comprensión en profundidad del código permite a los LLM realizar una detección de vulnerabilidades más precisa y una priorización inteligente basada en la gravedad y la explotabilidad.

Soporte de revisión de código en tiempo real

A diferencia del escaneado tradicional posterior al envío, las herramientas de IA se integran directamente en los IDE y las canalizaciones de CI, lo que permite una verdadera seguridad "shift-left". Programas como GitHub Copilot con CodeQL, los complementos IDE de Snyk y Qwiet AI proporcionan información en línea durante el desarrollo, destacando los patrones de código inseguro, explicando el riesgo y sugiriendo correcciones a medida que los desarrolladores escriben o revisan el código, todo ello dentro de su flujo de trabajo existente.

De la detección a la corrección

Un avance significativo es la capacidad de la IA para sugerir y aplicar correcciones. Las herramientas tradicionales se limitaban a señalar los problemas; ahora, las herramientas de IA ofrecen soluciones prácticas, transformando el flujo de trabajo de seguridad de "aquí hay un problema" a "aquí se explica cómo solucionarlo".

Autocorrección en función del contexto

Una de las características más impactantes de las herramientas de seguridad basadas en IA es su capacidad para generar por sí mismas correcciones específicas. Los sistemas de autocorrección suelen seguir un proceso estructurado:

Revisar el código: Enviar el fragmento de código defectuoso a la IA para su análisis.

Añadir contexto: Proporcionar reglas de seguridad y buenas prácticas

Encontrar el problema: analizar el flujo de código y los datos para comprender el fallo de seguridad.

Crear una solución: Escribir un nuevo código que solucione el problema sin que el programa deje de funcionar.

La reparación de seguridad mediante IA se centra sólo en las partes defectuosas, en lugar de reescribir funciones enteras. Varias empresas ofrecen herramientas con esta capacidad, como:

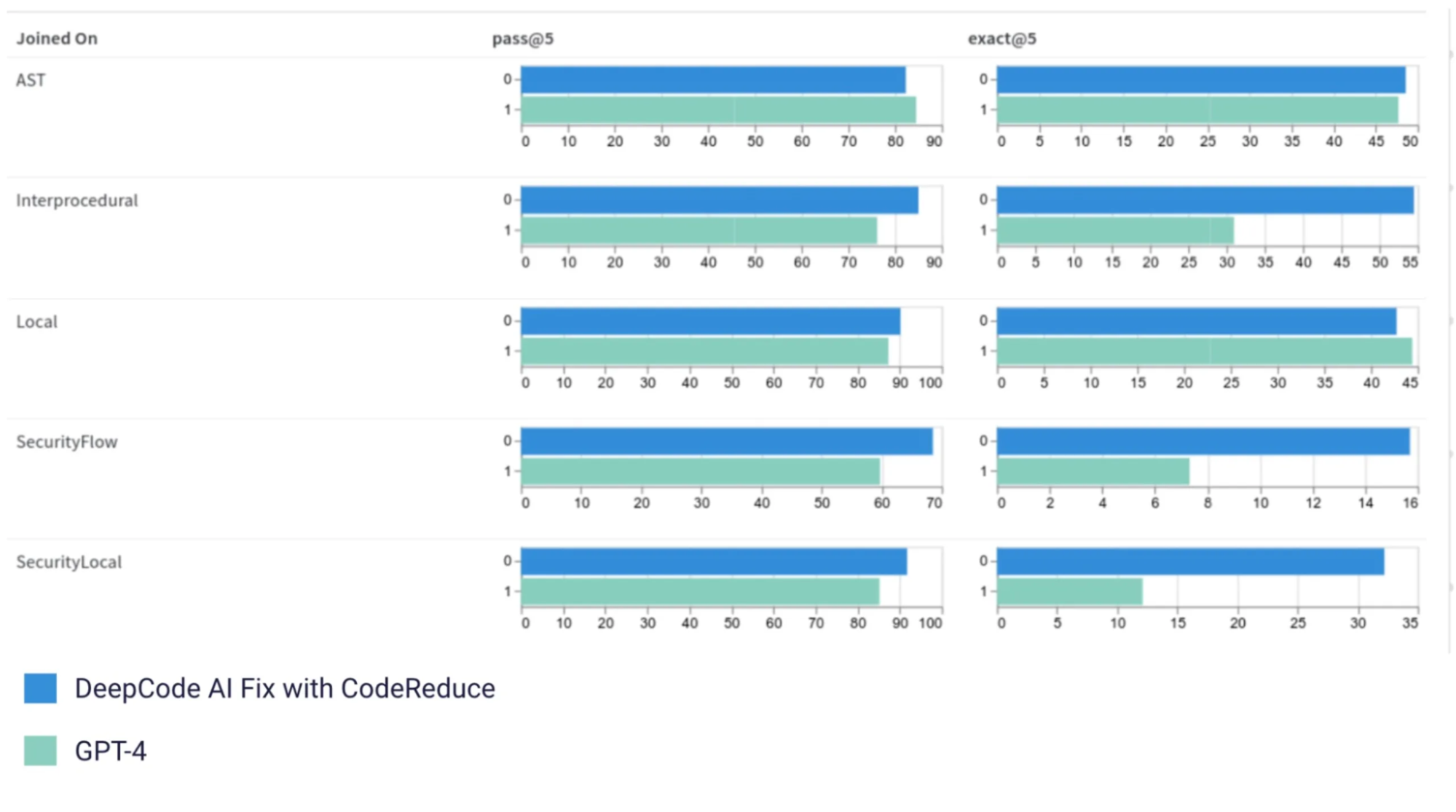

Snyk DeepCode AI Fix combina LLM con técnicas de análisis estático. Comenzó con modelo T5 de Google de Google, pero ahora utiliza StarCoderque se entrena en problemas de seguridad fijos. La tecnología CodeReduce de Snyk de Snyk centra la IA únicamente en las secciones de código vulnerables, logrando hasta un 20% más de precisión que GPT-4 y reduciendo al mismo tiempo los falsos positivos. El sistema MergeBack garantiza una integración limpia de las correcciones en las bases de código existentes.

Fuente: Snyk blog post

AutoFix de Qwiet AI de Qwiet AI emplea varios agentes de IA que trabajan con Gráfico de propiedades del código (CPG). CPG mapea cómo funciona una aplicación, mostrando el flujo de datos y la estructura del código en una sola vista. Este enfoque destaca en vulnerabilidades complejas como las condiciones de carrera y los ataques de inyección SQL.

GitHub Copilot AutoFix ofrece sugerencias de corrección en tiempo real directamente en los editores de código para las vulnerabilidades detectadas por CodeQL en tiempo real. Ayuda a los desarrolladores a aplicar patrones de codificación segura mientras escriben, reduciendo el cambio de contexto y mejorando la velocidad de corrección dentro de flujos de trabajo familiares.

CodeRabbit ofrece revisiones de código asistidas por IA directamente dentro de las solicitudes de extracción de GitHub. Puede identificar problemas de seguridad, sugerir correcciones en función del contexto y dar soporte a los bucles de retroalimentación de los desarrolladores, todo ello sin salir de la interfaz de usuario de GitHub. En nuestro reciente seminario web sobre IA con CodeRabbitlas PYMES compartieron cómo CodeRabbit aporta IA a sus revisiones de código, ayudándole a ahorrar hasta un 50% del tiempo invertido en revisiones manuales.

Reducción de falsos positivos con contexto de código

Los escáneres tradicionales a menudo producen resultados ruidosos debido a una comprensión limitada del comportamiento del código. Las herramientas de IA mejoran la precisión analizando:

Cómo fluyen los datos a través de funciones y módulos

Si la entrada está desinfectada o validada

Patrones comunes de codificación segura

La diferencia entre riesgos teóricos y fallos explotables

Orientación en lenguaje natural para desarrolladores

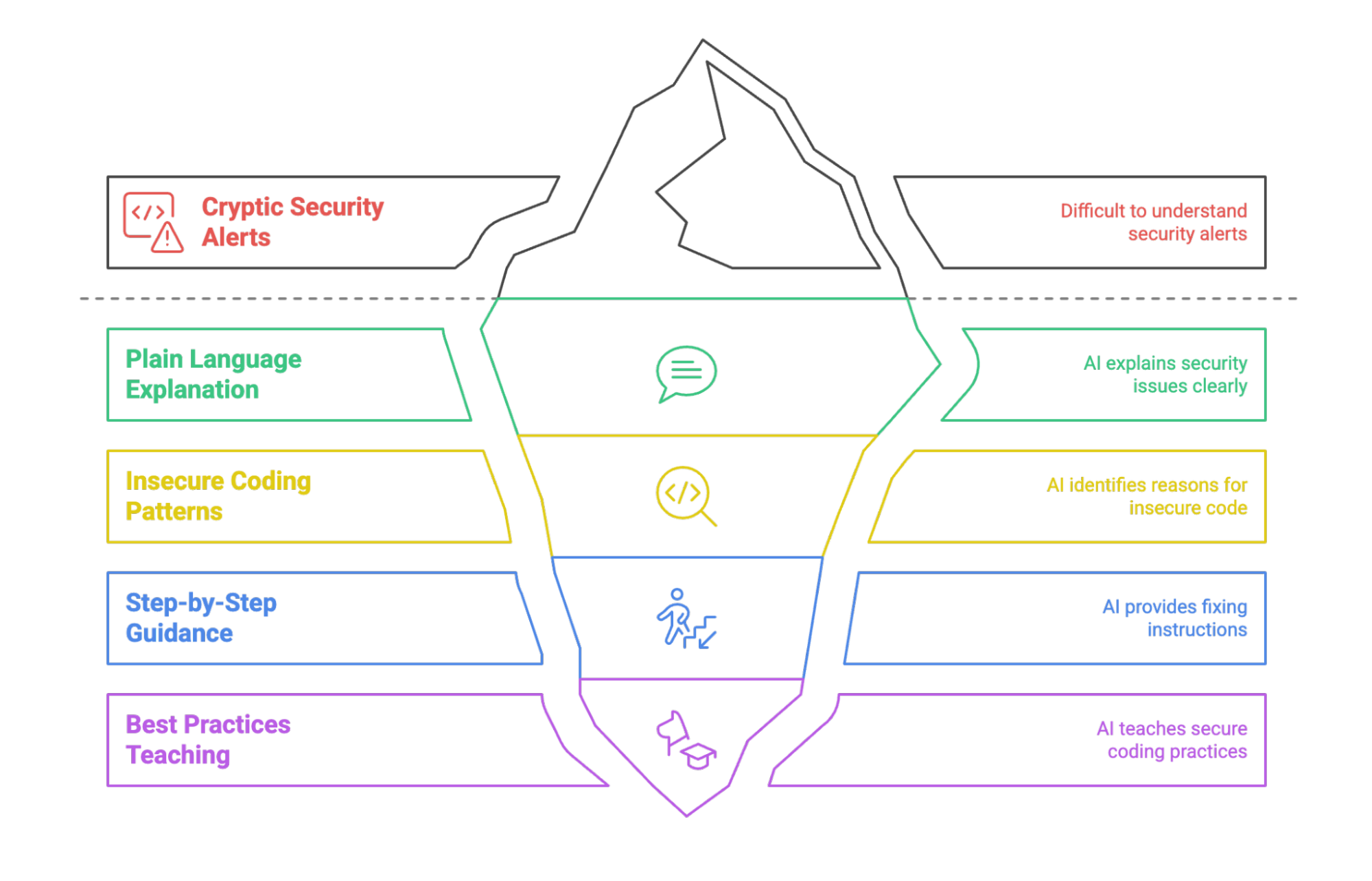

La IA transforma las crípticas alertas de seguridad en orientaciones prácticas:

Explicar los problemas en un lenguaje sencillo

Resaltando por qué un patrón de codificación es inseguro

Ofrece orientación paso a paso para solucionar problemas

Enseñando las mejores prácticas mientras se trabaja

Por ejemplo, en una GitHub pull requestCodeRabbit proporcionó información completa como:

"CRÍTICO: Corregir graves errores de seguridad en el cubo S3. La configuración actual tiene varios problemas de seguridad críticos: El acceso público de lectura está habilitado a través de ACL, la política CORS permite peticiones de cualquier origen, Todas las cabeceras están permitidas. Estas configuraciones podrían conducir a accesos no autorizados, fuga de datos y abuso potencial de tus recursos S3."

A continuación, la IA proporcionó correcciones de código específicas, explicó las implicaciones de seguridad y sugirió mejoras arquitectónicas, yendo mucho más allá de la simple detección de vulnerabilidades para ofrecer una guía de revisión de código exhaustiva que ayuda a los desarrolladores a comprender tanto el problema como la solución.

Del mismo modo, GitHub Copilot puede sugerir correcciones en línea al tiempo que ofrece explicaciones en lenguaje natural basadas en el análisis CodeQL. Esta información ayuda a los desarrolladores a comprender la vulnerabilidad y aplicar una corrección sin salir de su entorno de codificación.

Juntos, estos avances están ayudando a los equipos a corregir errores antes, reducir el tiempo dedicado a la clasificaci�ón y mantener un código seguro con menos sobrecarga manual. Con estos avances en marcha, veamos cómo las organizaciones están poniendo en práctica hoy en día la seguridad impulsada por la IA.

Cómo utilizan las organizaciones la IA para AppSec en 2025

Las organizaciones están integrando herramientas de seguridad de IA a través de múltiples patrones de implementación:

Integración del entorno de desarrollo: Los equipos integran herramientas de seguridad de IA directamente en IDEs como VS Code, IntelliJ y Visual Studio. Los desarrolladores reciben alertas de vulnerabilidad en tiempo real y sugerencias de corrección mientras escriben código, con herramientas como GitHub Copilot Security y las extensiones IDE de Snyk liderando la adopción.

Integración de canalizaciones CI/CD: Las organizaciones integran el análisis de seguridad de IA en los flujos de trabajo de integración continua. Las herramientas analizan automáticamente las confirmaciones de código, las solicitudes de extracción y las compilaciones, y bloquean las implantaciones cuando se detectan vulnerabilidades críticas. Las empresas informan de una codificación segura un 55% más rápida con GitHub Copilot y una corrección de vulnerabilidades hasta un 60 % más rápida con Snyk.

Automatización de la revisión de la seguridad: Los equipos de seguridad utilizan herramientas de IA para aumentar las revisiones manuales de código, señalando automáticamente posibles problemas para su verificación humana. Este enfoque híbrido combina la velocidad de la IA con la experiencia humana para la toma de decisiones críticas.

Corrección de código heredado: Las organizaciones aplican herramientas de IA para escanear y corregir vulnerabilidades en bases de código existentes. Qwiet AI informa de una reducción de hasta el 95% en los tiempos de corrección para patrones de vulnerabilidad comunes cuando se aplica a sistemas heredados.

Formación y transferencia de conocimientos: Los equipos de desarrollo utilizan las explicaciones y sugerencias de corrección generadas por la IA como herramientas de aprendizaje, lo que les permite adquirir conocimientos sobre seguridad al tiempo que abordan las vulnerabilidades inmediatas.

La adopción actual se centra en tipos de vulnerabilidades comunes, inyección SQL, secuencias de comandos en sitios cruzados (XSS), fallos de autenticación y manejo inseguro de datos, donde las herramientas de IA demuestran la mayor precisión y fiabilidad.

Retos en la adopción en el mundo real

A pesar de sus prometedoras capacidades, las herramientas de seguridad de IA plantean varios retos cuando se trata de su adopción en el mundo real:

Calidad y precisión de las correcciones: Aunque el 80% de precisión representa un progreso sustancial, la tasa de fallos del 20% plantea graves riesgos. Las correcciones incompletas o incorrectas pueden introducir nuevas vulnerabilidades o romper la funcionalidad de las aplicaciones.

Lagunas en el contexto del sistema: Muchas herramientas pueden analizar ahora carpetas o varios archivos, pero siguen existiendo limitaciones, especialmente en bases de código de gran tamaño o entornos de microservicios. Las correcciones sugeridas pueden funcionar de forma aislada pero fallar cuando se aplican a sistemas interconectados sin un contexto más amplio.

Complejidad de la integración: Las organizaciones luchan por incorporar las herramientas de seguridad de IA a los flujos de trabajo de aprobación, las políticas de seguridad y los requisitos de cumplimiento existentes. Los formatos de salida incoherentes y la falta de informes estandarizados (como SARIF) complican la integración.

Preocupación por la privacidad y el tratamiento de datos: Algunas herramientas se basan en grandes modelos de lenguaje basados en la nube, que pueden plantear riesgos para la privacidad o el cumplimiento de la normativa cuando se analiza código propietario o sensible. Las organizaciones de sectores regulados como las finanzas, la defensa y la administración pública pueden dudar a la hora de adoptar herramientas que transmiten código a servidores externos sin garantías claras sobre el uso y la conservación de los datos.

Explicabilidad y confianza de los desarrolladores: Es más probable que los desarrolladores sigan las sugerencias de la IA si entienden los motivos. Mientras que herramientas como GitHub Copilot y CodeRabbit ofrecen explicaciones en línea, otras siguen funcionando como cajas negras, lo que hace más difícil confiar en los cambios automatizados, sobre todo en sistemas de alto riesgo.

Variabilidad del rendimiento: La eficacia de las herramientas de IA varía significativamente en función de los tipos de vulnerabilidades, lenguajes de programación y patrones arquitectónicos. Las herramientas que destacan en las vulnerabilidades de las aplicaciones web pueden tener problemas con los sistemas integrados o las implementaciones criptográficas.

Lo que viene: agentes más seguros e inteligentes

El panorama de la seguridad de la IA está evolucionando hacia soluciones más sofisticadas y conscientes del contexto:

Comprensión exhaustiva del código: Las herramientas de análisis de código basadas en IA, como CodeRabbit y GitHub Copilot con CodeQL, ya analizan varios archivos y módulos para comprender la estructura general del código. La próxima oleada reforzará esto incorporando lógica entre servicios, resolución de dependencias y conocimientos arquitectónicos más profundos.

Integración inteligente del flujo de trabajo: Las herramientas de IA están cada vez más integradas directamente en las solicitudes de extracción, los procesos CI/CD y los IDE. Por ejemplo, CodeRabbit se ejecuta en los PR de GitHub y sugiere correcciones sin interrumpir el flujo de revisión. Se espera una mayor integración con los gestores de incidencias, los flujos de trabajo de aprobación y los motores de políticas...

Asistencia de seguridad conversacional: Las interfaces basadas en el chat permiten a los desarrolladores iterar sobre las correcciones a través del lenguaje natural, perfeccionando las soluciones en colaboración con la orientación de la IA.

Aprendizaje específico de la organización: Los sistemas avanzados se adaptarán a los estándares de codificación, patrones arquitectónicos y políticas de seguridad específicos de cada empresa, proporcionando recomendaciones cada vez más personalizadas a lo largo del tiempo.

Priorización de riesgos mejorada: Los sistemas de puntuación mejorados tendrán en cuenta el contexto empresarial, la sensibilidad de los datos y el panorama de amenazas para ayudar a los equipos a centrarse primero en las vulnerabilidades más críticas.

Más características: Los desarrolladores quieren ajustar el comportamiento de las herramientas. Funciones como la supresión de alertas, la exploración por ámbitos, la configuración de políticas y el análisis consciente de las dependencias se están convirtiendo en expectativas estándar, no en extras opcionales.

Conclusión: desplazar la seguridad hacia la izquierda, con inteligencia

Las herramientas de seguridad de aplicaciones basadas en IA representan un cambio fundamental de la detección reactiva a la corrección proactiva. Al automatizar el descubrimiento de vulnerabilidades y sugerir correcciones en función del contexto, las herramientas de IA permiten a los desarrolladores abordar los problemas de seguridad en una fase más temprana del ciclo de vida de desarrollo, lo que reduce tanto los costes como los riesgos.

Espero que este resumen haya ayudado a aclarar cómo se utiliza actualmente la IA en la seguridad de las aplicaciones y qué podría aportar la próxima oleada de tecnología a la seguridad de las aplicaciones. Para obtener más información sobre lo último en IA, póngase en contacto con nosotros.